Cerebras Systems vient de dévoiler sa puce WSE (Wafer-scale Engine) de troisième génération, WSE-3, qui contient 4 000 milliards de transistors et 900 000 cœurs optimisés pour l'IA.

VOIR LA GALERIE – 3 IMAGES

Advertisement

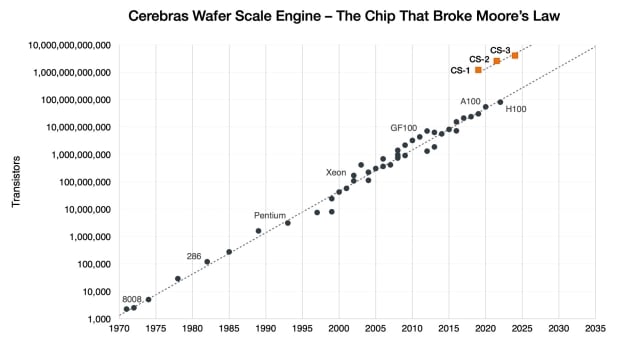

La société n'a pas arrêté son parcours en matière de lancement de processeurs IA, avec des spécifications vraiment folles pour la nouvelle puce WSE-3 de Cerebras. Nous disposons de 4 000 milliards de transistors, de 900 000 cœurs optimisés pour l'IA, de 125 pétaflops de performances maximales de l'IA et de 44 Go de SRAM sur puce réalisés sur le nœud de processus 5 nm de TSMC.

WSE-3 dispose également de 1,5 To, 12 To ou 1,2 Po de mémoire externe (oui, 1,2 pétaoctets de mémoire) capable de former des modèles d'IA avec jusqu'à 24 000 milliards de paramètres. Cerebras affirme que son nouveau WSE-3 a une taille de puce de 46 225 mm2, ce qui est 57 fois plus grand que l'actuel GPU H100 AI de NVIDIA, qui mesure 826 mm2.

Le GPU H100 AI actuel de NVIDIA comprend 16 896 cœurs et 528 cœurs Tensor, mais le nouveau Cerebras WSE-3 dispose d'un nombre insensé de 900 000 cœurs optimisés pour l'IA (par puce), soit une augmentation massive de 52 fois par rapport au H100. Des trucs incroyables, des trucs vraiment incroyables.

Passons maintenant aux 21 pétaoctets par seconde de bande passante mémoire… ce qui est ahurissant 7 000 fois plus que le H100, avec 214 pétabits par seconde de bande passante de structure (3 715 fois plus rapide que le H100). Cerebras dispose de 44 Go de mémoire sur puce, soit 880 fois plus que le GPU H100 AI actuel de NVIDIA. Chaque numéro dont dispose Cerebras fait honte à ses concurrents.

Advertisement

Combien coûte la nouvelle puce WSE-3 AI ? C'est quelque chose que nous ne savons pas, mais ne vous attendez pas à ce qu'ils soient bon marché.

Andrew Feldman, PDG et co-fondateur de Cerebras a expliqué : « Lorsque nous avons commencé ce voyage il y a huit ans, tout le monde disait que les processeurs à l'échelle des tranches étaient une chimère. Nous ne pourrions être plus fiers de présenter la troisième génération de notre processeur révolutionnaire. Puce IA à l'échelle de l'eau. WSE-3 est la puce IA la plus rapide au monde, spécialement conçue pour les derniers travaux d'IA de pointe, du mélange d'experts aux modèles de 24 000 milliards de paramètres. Nous sommes ravis d'apporter WSE-3 et CS- 3 sur le marché pour aider à résoudre les plus grands défis actuels en matière d'IA ».

Points forts de la spécification Cerebras WSE-3 :

- 4 000 milliards de transistors

- 900 000 cœurs d’IA

- 125 pétaflops de performances IA maximales

- 44 Go de SRAM sur puce

- Processus TSMC 5 nm

- Mémoire externe : 1,5 To, 12 To ou 1,2 Po

- Entraîne des modèles d'IA jusqu'à 24 000 milliards de paramètres

- Taille de cluster allant jusqu'à 2 048 systèmes CS-3

Rick Stevens, directeur associé du laboratoire d'Argonne National Laboratory pour l'informatique, l'environnement et les sciences de la vie, a déclaré : « En tant que partenaire de longue date de Cerebras, nous sommes intéressés de voir ce qui est possible avec l'évolution de l'ingénierie à l'échelle de la tranche. CS-3 et les supercalculateurs basés sur cette architecture alimentent des systèmes à grande échelle qui nous permettent d'explorer les limites de l'IA et de la science aux frontières. L'audace de Cerebras continue d'ouvrir la voie à l'avenir de l'IA« .