NVIDIA od miesięcy produkuje ograniczone procesory graficzne AI, aby ominąć amerykańskie ograniczenia eksportowe w Chinach, ale wygląda na to, że zmodyfikowane procesory graficzne Ampere A100 AI również tam krążą.

ZOBACZ GALERIĘ – 4 ZDJĘCIA

Advertisement

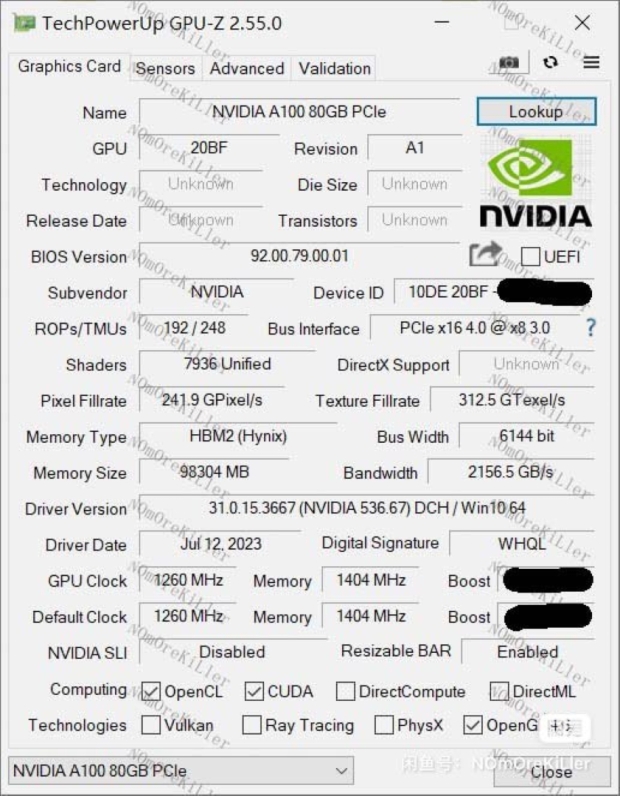

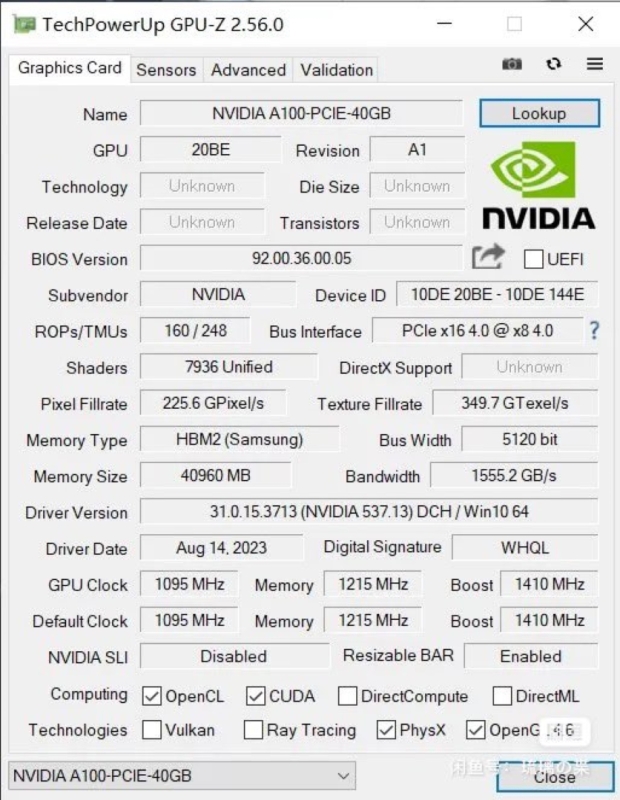

Procesory graficzne NVIDIA A100 7936SP 96 GB + 40 GB AI (źródło: Jiacheng Liu)

Nowa NVIDIA A100 7936SP –nie prawdziwe imię; nazwa ta opiera się na liczbie rdzeni CUDA – ma ten sam procesor graficzny GA100, co zwykły A100 – ale z 15% większą liczbą rdzeni CUDA. Zwykły A100 ma 124 SM (multiprocesory strumieniowe), podczas gdy nowy A100 7936SP ma łącznie 128 SM.

Nowy A100 7936SP ma także więcej pamięci HBM2e – 96 GB pamięci HBM2e w porównaniu do zaledwie 80 GB HBM2e na standardowym procesorze graficznym A100 AI. Dzięki dodatkowym 4 modułom SM nowy A100 7936P charakteryzuje się 15% wzrostem liczby SM, CUDA i Tensor Core, co powinno przekładać się na co najmniej 15% większą wydajność sztucznej inteligencji we wszystkich obszarach.

Ampere A100 poprzedniej generacji firmy NVIDIA jest oferowany w konfiguracjach 40 GB i 80 GB, podobnie jak nowy A100 7936SP w wersjach 80 GB i 96 GB w Chinach.

Advertisement

Nowy wariant A100 7936SP 40 GB charakteryzuje się ogromnym wzrostem podstawowych zegarów GPU, z 765 MHz w standardowym A100 do imponujących 1215 MHz (to ogromny wzrost o 59%.) w nowym A100 7936SP. Oba zegary w trybie Boost w wariantach 40 GB mają częstotliwość 1410 MHz.

Jeśli chodzi o sam procesor graficzny, A100 7936SP 40 GB ma włączone 124 SM, z 7936 rdzeniami CUDA (duh, nazwa) i 496 rdzeniami Tensor / AI. Tymczasem standardowy A100 40 GB zawiera 6912 rdzeni CUDA i 432 rdzenie Tensor/AI, co stanowi znaczną redukcję w stosunku do obecnie mega-A100 7936SP 40 GB w Chinach.

Porozmawiajmy teraz o pamięci VRAM. Najwyższej klasy procesor graficzny AI A100 7936SP 96 GB ma więcej pamięci VRAM – przy 96 GB HBM2e w porównaniu z 80 GB HBM2e w standardowym A100 – ale jest też umieszczony na szerszej magistrali. Nowy procesor graficzny A100 7936SP AI ma 96 GB pamięci HBM2e rozmieszczonej na 6144-bitowej magistrali pamięci, która zapewnia przepustowość pamięci do 2,16 TB/s, w porównaniu z 5120-bitową szyną pamięci i przepustowością pamięci 1,94 TB/s w standardowej wersji Karta graficzna A100 80 GB AI.

Podsystem VRAM w nowym A100 7936SP 40 GB jest identyczny jak w A100 40 GB: 40 GB pamięci HBM2e na 5120-bitowej magistrali pamięci z przepustowością pamięci do 1,56 TB/s.

Obecne procesory graficzne NVIDIA A100 80 GB i A100 40 GB AI mają TDP odpowiednio 300 W i 250 W, więc powinniśmy się spodziewać, że ulepszony A100 7936SP 96 GB będzie miał nieco wyższy TDP, około 350 W.

Widzimy, że chińscy sprzedawcy oferują model A100 7936SP 96 GB w cenie od 18 000 do 19 800 dolarów; i nawet nie wiemy, czy te akceleratory AI to próbki inżynieryjne, które wyciekły z własnych laboratoriów NVIDII, czy też niestandardowe modele opracowane przez producenta chipów dla konkretnego klienta. Cokolwiek to jest, te karty są prawdziwe i mają większą moc, niż pozwalają na to amerykańskie przepisy eksportowe.