以前は Facebook として知られていたこの企業は、昨日、Meta の新しい AI 製品を強化するための強力な AI ハードウェアの一部を提供する可能性がある Intel と協力して、いくつかの大きな発表を行いました。 知っておくべき大きな新事実は、Llama 3 AI モデルと、単に「Meta AI」と呼ばれる Meta の新しい AI アシスタントです。

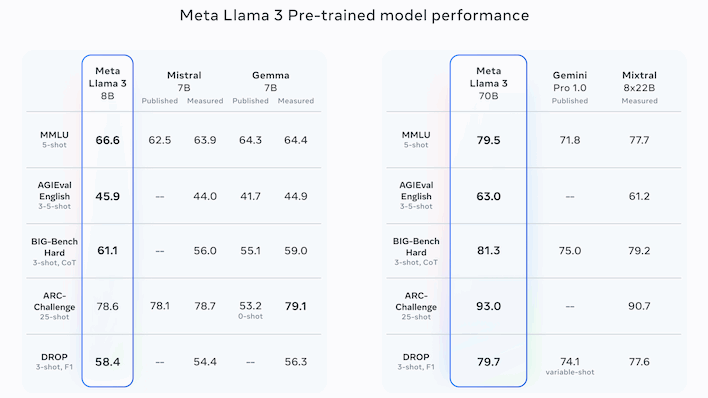

Meta の大規模言語モデル Llama ファミリは、皮肉な名前の OpenAI の GPT シリーズや Google の Gemini ファミリなど、クローズドソースのリーダーとパフォーマンスの点で競合しているにもかかわらず、オープンソースであり続けていることで注目に値します。 Llama の最新版は Llama 3 で、これには 2 つのバージョンがあり、1 つは 80 億のパラメータを備え、もう 1 つは 700 億のパラメータを備えています。

Advertisement

Meta 自体が提示したベンチマークから外れると、完全な 70B バージョンは OpenAI の GPT-4 とほぼ競合するようです (Meta 自体が行った比較ではありません)。 その代わりに同社は、GoogleのGeminiモデルやGemmaモデル、AnthropicのClaude 2、フランスMistral AIのMistralモデルやMixtralモデルなど、あまり人気のないライバルとの比較に重点を置いているようだ。

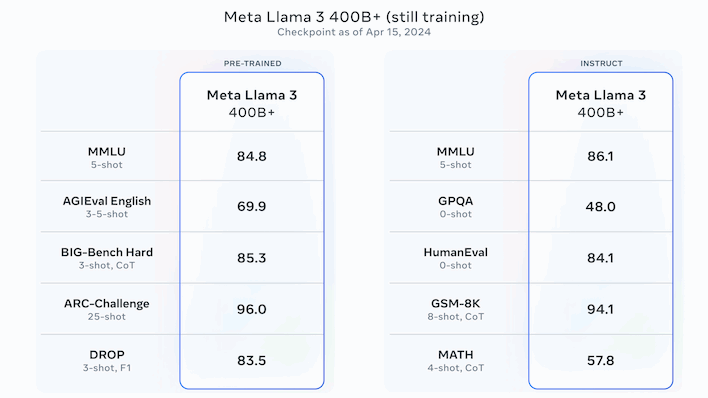

全体として、この数字は説得力がありますが、Meta は LLM への取り組みをまだ終えていません。 メタ氏によると、ラマ 3 の最大バージョンは 4,000 億以上のパラメータがあり、まだトレーニング中だという。 上記の数値はそのモデルに関するもので、おそらくオープンソース リリースとなるものから見た中では全体的に最高のものです。 Meta氏によると、Llama 3は「今後数か月以内に」マルチモダリティ(画像、音声、おそらくビデオ)、複数言語のサポート、より長いコンテキストウィンドウなどの機能を追加する追加リリースが予定されているという。

特に、Llama 3 はオープンソースであるため、モデルを今すぐダウンロードしてローカルで遊ぶことができます。 ただし、これには注意点があります。 ダウンロードにはシェル スクリプトを使用する必要があるため、Bash 環境をセットアップする必要があります。 これは、AI 研究者、ほとんどの開発者、および多くのパワー ユーザーにとっては簡単なはずですが、カジュアルな AI 愛好家であれば、よりアクセスしやすいパッケージを待ったほうがよいかもしれません。

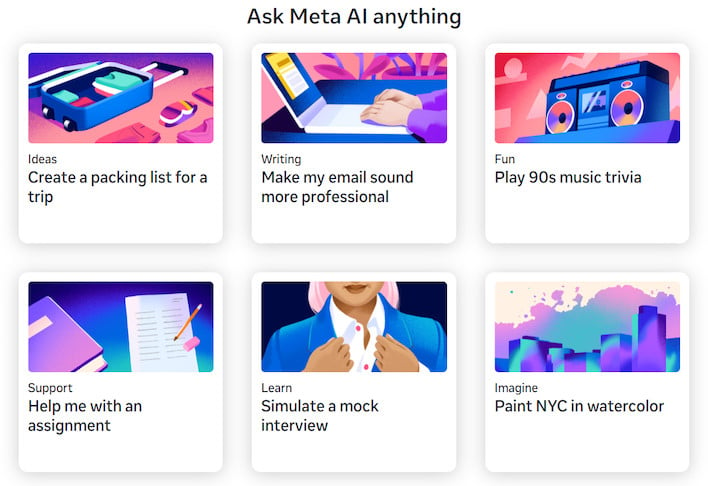

確かに、あなたが AI 研究者であれば、これはまったく問題なく、良いことですが、通常のユーザーの場合はどうでしょうか? まあ、(理論的には) Meta の新しい Meta AI アシスタントを使用して Llama 3 を試すことはできます。 このアシスタントは Facebook、Instagram、WhatsApp、Messenger アプリの最新バージョンに組み込まれており、お勧めのレストラン、ナイトライフのアクティビティの検索、教育の支援、画像の生成などの機能を実行できます。 新しいサイト Meta.ai でも遊ぶことができますが、何か面白いことをするには Facebook アカウントが必要です。ログインした後でもサイトにアクセスできませんでした。

Advertisement

この再構成の欠点の 1 つは、Meta の Imagine AI 生成機能が新しい Meta AI サイトに組み込まれていることです。 以前はユーザーに Meta アカウントでのログインを許可していましたが、画像の生成には Facebook アカウントが必要になり、匿名ユーザーが計算量の多い画像生成リクエストで Meta のサーバーを攻撃することを防ぐ可能性があります。 ただし、作成した画像を取得して反復処理したり、アニメーション化したりして、ユーザーがそれらを GIF 形式で友人と共有できるようにする機能など、いくつかの新しいトリックを学習しました。 とてもクールなものです。

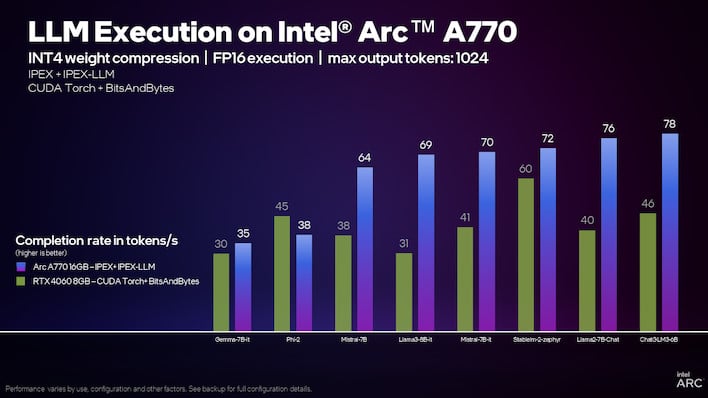

Intel によれば、言語モデルに関しては Arc A770 が RTX 4060 よりもかなり高速です。

Meta の新しい AI への取り組みにおける Intel の役割は完全には明らかではありませんが、それでも Intel はそれらに熱心に取り組んでいます。 同社は、Llama 3 実行中の Core Ultra および Xeon CPU、Arc GPU、Gaudi アクセラレータの高性能を誇る複数のリリースや記事を発表しました。

特に同社は、Core Ultra CPU に統合された Arc GPU が「すでに [text] 一方、8 パックの Gaudi 2 チップは、10 個のプロンプトを一度に実行しながら、1 秒あたり約 131 文を生成できるようです。次期 Xeon 6 プロセッサは、Sapphire Rapids の 2 倍高速であるようです。ラマ3も。

Arc ディスクリート GPU に関する限り、Intel は実際に、Arc GPU でローカルに実行する大規模な言語モデルをセットアップする方法を示す拡張チュートリアルを用意しています。 これについては、Intel が最初に発表したときに取り上げましたが、セットアップ プロセスが非常に複雑であるにもかかわらず、現時点での最終結果はかなりユーザー フレンドリーになっているようです。 Arc GPU を使用していて、PC 上で直接実行されている LLM とチャットしたい場合は、次のことができます。 Intel のガイドにアクセスしてください ウォークスルー用に。